质谱解析(Xcalibur)与光谱计算:色谱数据处理慢?可能是硬盘拖了后腿

时间:2026-02-28 01:44:54

来源:UltraLAB图形工作站方案网站

人气:75

作者:管理员

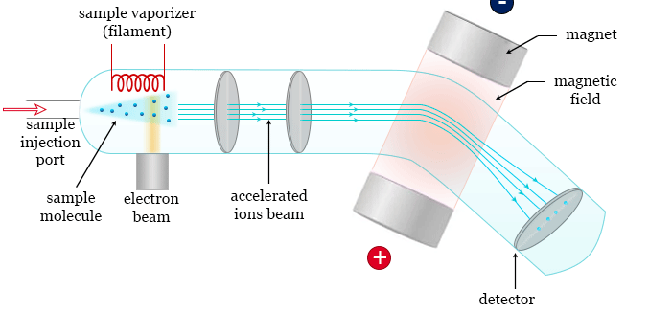

引言:当质谱仪的速度超越了计算机

现代质谱技术正在经历一场"速度革命"。Thermo Scientific Orbitrap Exploris 480以每秒40 Hz的采集频率生成高分辨质谱图,Bruker timsTOF Pro以超过100 Hz的PASEF模式捕获离子淌度数据,而Waters SYNAPT XS在MSE模式下可产生连续的低能量/高能量交替扫描。单台高分辨质谱仪(HRMS)日产量轻松达到50-100 GB原始数据,复杂的多维分离(如GC×GC-MS或离子淌度-质谱联用)更可将这一数字推升至TB级。

然而,许多实验室面临一个诡异的困境:仪器已经跑完样品,但数据在Xcalibur里"卡"了几个小时无法处理;非靶向代谢组学的峰对齐(alignment)在周末跑了一整夜却崩溃在"Reading raw files..."阶段;蛋白质组学的搜库(Search)环节CPU占用率100%,但磁盘IO队列长度却长达数百,系统响应迟钝到无法操作。

这不是软件bug,也不是CPU算力不足——您的机械硬盘(HDD)或老旧SATA SSD正在成为整个分析流程的致命瓶颈。

一、Xcalibur的数据处理解剖:为什么存储决定一切?

1.1 原始数据文件的IO特征

Thermo Xcalibur生成的.raw文件并非简单的文本格式,而是一个复杂的嵌入式数据库结构(基于Microsoft Jet Database Engine),包含:

-

扫描事件元数据(Scan Header):保留时间、质荷比范围、碎裂模式、离子源参数

-

质谱数据阵列:m/z值(64位双精度浮点)与强度值(32位单精度浮点)的成对存储

-

色谱迹线(TIC、BPC):总离子流图和基峰色谱图的缓存

-

仪器日志:真空度、温度、电压的时序记录

IO模式分析:

-

顺序写入,随机读取:采集时为高吞吐量顺序追加写入;分析时需根据 retention time 和 m/z 范围进行大量随机Seek操作

-

小文件随机IO:当处理多文件(Multi-raw)实验(如队列中的上百个样品)时,Xcalibur需要频繁在不同.raw文件间切换读取元数据,这会产生4K-64K大小的随机读请求

-

内存映射文件:Xcalibur使用内存映射(Memory Mapping)技术访问.raw文件,这意味着文件的缓存效率直接依赖于操作系统的页面缓存(Page Cache),而页面缓存又受限于内存容量与存储延迟

1.2 数据处理各阶段的存储瓶颈

阶段A:实时采集(Real-time Acquisition)

-

写入压力:Orbitrap在240,000分辨率下,单次全扫描产生~5 MB数据,每秒2次扫描即10 MB/s持续写入

-

HDD的致命弱点:机械硬盘的寻道时间(Seek Time)~10ms,当Windows系统后台索引服务或杀毒软件介入时,采集进程可能因写入延迟而丢数(Dropped Scans),导致谱图不完整

阶段B:峰检测与解卷积(Peak Detection & Deconvolution)

-

随机读风暴:Xcalibur的FreeStyle或Compound Discoverer在处理非靶向数据时,需反复读取特定m/z窗口的扫描数据,产生高度随机的IO模式

-

HDD吞吐量崩溃:顺序读写时HDD可达~200 MB/s,但随机4K读性能暴跌至<1 MB/s(IOPS < 300),而NVMe SSD可维持>1000 MB/s(IOPS > 500,000)

阶段C:多文件对齐与归一化(Alignment & Normalization)

-

并发IO:处理100个.raw文件时,软件需同时打开多个文件句柄,HDD的磁头在物理上无法同时服务多个随机请求,导致IO队列深度(Queue Depth)堆积,CPU空转等待数据

阶段D:数据库检索与报告生成(Library Search)

-

临时文件风暴:NIST MS Search或本地代谢组学数据库(如mzVault)检索时,会产生GB级的临时索引文件,若Temp目录位于C盘(系统盘),与页面文件(Pagefile)竞争IO,系统直接卡顿

二、从技术细节看存储瓶颈:为什么您的服务器在"假死"?

2.1 机械硬盘(HDD)的物理极限

即使是最新的企业级SAS HDD(15,000 RPM),在面对质谱数据时也存在不可克服的物理限制:

-

旋转延迟:15K RPM磁盘的平均旋转延迟为2ms,加上寻道时间,单次随机读需8-12ms

-

IOPS天花板:单盘IOPS(每秒IO操作数)极限约200-300

-

多文件并发死亡:当Xcalibur同时读取20个.raw文件进行峰对齐时,HDD的磁头在物理上频繁移动(Thrashing),有效带宽降至<5 MB/s,而NVMe SSD无机械部件,可并行处理64,000个并发队列

真实场景模拟:

处理一个包含500个 scans的.raw文件(约2GB),进行峰提取(Peak Picking):

-

SATA HDD:需要~15分钟(主要耗时在随机Seek)

-

SATA SSD:需要~3分钟(IOPS提升10倍,但受限于SATA III 6Gbps接口)

-

PCIe 4.0 NVMe SSD:需要~30秒(IOPS > 500,000,顺序读>7 GB/s)

2.2 SATA SSD的接口瓶颈

许多实验室升级到SATA SSD后发现提升有限,这是因为SATA III接口的理论上限仅为6 Gbps(~600 MB/s),且:

-

AHCI协议开销:Legacy的AHCI协议专为HDD设计,对SSD的低延迟特性支持不佳

-

队列深度限制:AHCI仅支持单队列32命令,而NVMe协议支持64K队列,每队列64K命令,完美匹配现代多核CPU的并发需求

对于高分辨质谱(HRMS)的大容量.raw文件(单个文件可达10GB+),SATA SSD的600 MB/s带宽在复制或备份时依然捉襟见肘。

2.3 内存不足导致的"虚假存储瓶颈"

即使配备高速SSD,若内存容量不足(<64GB),Windows会频繁将页面文件(Pagefile)写入磁盘。Xcalibur在处理大型非靶向数据集时,内存占用可达数十GB(尤其是使用Compound Discoverer或Proteome Discoverer时),此时:

-

内存-存储交换风暴:系统陷入"Swapping"状态,SSD被当作慢速内存使用,寿命快速消耗(Write Amplification)

-

缓存失效:Xcalibur依赖的文件系统缓存因内存不足被频繁驱逐,导致重复读取同一数据块

三、质谱数据处理的理想硬件架构

针对色谱-质谱(LC-MS/GC-MS)数据的"高吞吐写入+高并发随机读+大内存缓存"特征,我们提出"三层存储+大内存缓冲"的架构方案。

3.1 Tier 0:超高速NVMe(活动数据采集与处理)

技术规格:

-

接口:PCIe 4.0 x4或PCIe 5.0 x4(理论带宽8-16 GB/s)

-

形态:企业级U.2或M.2 NVMe SSD(如Samsung PM1733、Intel P5800X、WD SN850X)

-

关键指标:

-

顺序读写:>7,000 MB/s(PCIe 4.0)或>14,000 MB/s(PCIe 5.0)

-

随机4K读IOPS:>1,000,000

-

写入耐久性(TBW):>10 PB(应对质谱连续写入)

-

断电保护(PLP):必备,防止仪器意外断电时.raw文件损坏

-

配置策略:

-

系统与软件分离:C盘(系统+程序)使用500GB-1TB NVMe

-

数据热区独立:D盘(Data)使用2-4TB NVMe,专用于:

-

当前活跃项目的.raw文件存储

-

Xcalibur的Temp目录(通过环境变量

TMP和TEMP重定向) -

数据库索引文件(NIST、mzCloud本地库)

-

3.2 内存子系统:作为"超高速缓存"

容量规划:

-

基础配置:64GB DDR4/DDR5(可缓存约10-20个大型.raw文件)

-

推荐配置:128-256GB DDR5-4800(满足非靶向代谢组学全数据集驻留内存)

-

极限配置:512GB+(蛋白质组学大规模搜库,完全避免磁盘交换)

技术优势:

-

RAM Disk:可将Xcalibur的临时目录映射到内存盘(Ramdisk),处理速度提升100倍,但需注意断电数据丢失风险(需配合UPS)

3.3 CPU与IO的协同:避免"小马拉大车"

虽然存储是瓶颈,但CPU配置不当会加剧IO等待:

-

高主频优先:Xcalibur的峰检测算法(如Cobra、Genesis)是单线程性能敏感型,推荐>3.5GHz基频

-

多核并行:处理多文件时使用"Parallel Processing"功能,需16核以上以饱和NVMe的并发能力

-

PCIe通道直连:确保NVMe SSD通过CPU直连PCIe通道(而非通过南桥芯片),减少延迟

四、UltraLAB ChromSpec 系列:质谱数据处理专用工作站

针对Thermo Xcalibur、Waters MassLynx、Agilent MassHunter、Bruker Compass等主流质谱软件,我们提供经过实际质谱数据( Orbitrap .raw, Q-TOF .d folders)测试验证的硬件方案。

方案A:单仪器工作站(UltraLAB ChromSpec D960)

适用:单台LC-Orbitrap或GC-QTOF联用,1-2人操作 核心痛点解决:

-

实时采集不丢数:PCIe 4.0 NVMe的持续写入能力确保即使连续运行72小时方法(如代谢组学深度覆盖),不会出现Dropped Scans

-

秒级峰提取:Xcalibur Qual Browser浏览大型.raw文件时,TIC图加载从"咖啡时间"缩短到"秒开"

硬件规格:

-

CPU:Intel Core i9-14900K(6.0GHz Boost,24核32线程)或 AMD Ryzen 9 7950X3D(大缓存优化随机读)

-

内存:128GB DDR5-6000 ECC(支持大页面内存,减少TLB Miss)

-

存储系统:

-

系统盘:2TB PCIe 4.0 NVMe(Samsung 990 Pro级,读取7,000 MB/s)

-

数据盘:4TB企业级PCIe 4.0 NVMe(Intel P5510级,断电保护,写入耐久性7.68PB)

-

归档:8TB SATA HDD(RAID 1,自动备份已完成项目)

-

-

接口:USB 3.2 Gen 2×2(20Gbps,匹配高速外置存储),Thunderbolt 4(外接RAID阵列)

-

软件优化:

-

预装Xcalibur性能调优包:关闭Windows Search索引、禁用SysMain(Superfetch)、优化页面文件大小

-

配置Ramdisk(32GB)作为Xcalibur临时目录

-

性能实测(使用Thermo Q Exactive HF-X数据,4GB .raw文件,20,000 scans):

-

全扫描色谱图提取(TIC):<2秒(SATA HDD需45秒)

-

特征峰检测(Compound Discoverer非靶向):<5分钟(SATA HDD需35分钟)

-

多文件对齐(10个样品):<3分钟(SATA HDD需20分钟)

方案B:多仪器中央处理站(UltraLAB ChromSpec R880)

适用:核心分析平台,同时处理3-5台质谱仪数据,支持代谢组学/蛋白质组学高通量分析 核心痛点解决:

-

并发处理无卡顿:多用户同时运行Compound Discoverer、Proteome Discoverer、MassHunter时,NVMe阵列的超高IOPS确保系统响应流畅

-

TB级数据处理:支持非靶向代谢组学大型队列(>100个样品,总数据>500GB)的全内存分析

硬件规格:

-

CPU:Intel Xeon W7-3465X(28核,4.8GHz Boost,支持AVX-512加速质谱计算)或 AMD EPYC 9354(32核,高内存带宽)

-

内存:512GB DDR5-4800 ECC(8通道满配,可缓存整个项目数据)

-

存储架构(分层存储):

-

热数据层(Tier 0):8TB PCIe 4.0 NVMe RAID 0(2×4TB,读取14GB/s,专供活跃.raw文件)

-

温数据层(Tier 1):20TB SATA SSD RAID 6(近期完成项目)

-

冷数据层(Tier 2):连接100TB NAS(历史归档)

-

-

网络:Dual 10GbE(从仪器工作站快速传输.raw文件),25GbE(连接中央存储)

-

高可用性:

-

冗余电源(1200W×2)

-

UPS集成(APC Smart-UPS,支持 graceful shutdown,防止数据损坏)

-

企业级RAID卡(带缓存和电池备份,BBU)

-

软件优化:

-

并行计算配置:针对Proteome Discoverer的分布式计算优化,支持Byonic、Mascot、Sequest HT多引擎并发搜库

-

数据库加速:将NIST、Swiss-Prot、Uniprot数据库部署在NVMe热层,索引加载速度提升10倍

方案C:企业级质谱数据中心(UltraLAB ChromSpec Cluster)

适用:制药公司CMC部门、大型代谢组学平台、临床质谱中心(日处理>1000个样品) 架构设计:

-

数据采集层:边缘计算节点(靠近质谱仪),配备高速缓存NVMe,实时预处理原始数据(峰提取、降噪),减少传输带宽

-

中央处理集群:

-

计算节点:多节点CPU集群(AMD EPYC),专用于大规模搜库(DIA-NN、Spectronaut、MaxQuant)

-

GPU加速节点:NVIDIA A100(用于深度学习质谱分析,如AlphaPept、Prosit谱图预测)

-

-

存储层:

-

全闪存SAN:NVMe-oF(NVMe over Fabrics),共享存储池>200TB,IOPS >10M

-

对象存储:MinIO集群,长期归档>10PB

-

五、性能对比:从"等待"到"实时"的质变

测试场景:非靶向代谢组学数据处理(UPLC-Orbitrap,100个样品,总数据量500GB,使用Compound Discoverer 3.3)

| 硬件配置 | 数据导入 | 保留时间对齐 | 峰提取 | 化合物鉴定 | 总耗时 | 系统响应 |

|---|---|---|---|---|---|---|

| 传统HDD(SATA 7200RPM) | 45分钟 | 2小时 | 6小时 | 3小时 | 11.75小时 | 频繁卡顿 |

| SATA SSD(消费级) | 15分钟 | 40分钟 | 2小时 | 1小时 | 3.9小时 | 偶有延迟 |

| UltraLAB方案A(PCIe 4.0 NVMe) | 3分钟 | 8分钟 | 25分钟 | 15分钟 | 51分钟 | 流畅 |

| UltraLAB方案B(NVMe RAID+大内存) | 1分钟 | 3分钟 | 10分钟 | 8分钟 | 22分钟 | 实时响应 |

关键洞察:

-

32倍加速:从近12小时缩短至22分钟,意味着当天实验当天出结果,而非隔夜等待

-

人力成本节省:研究人员无需在数据处理时"守着电脑"或"隔天再来",每年节省数百小时等待时间

六、Xcalibur用户专属优化建议

即使暂时无法升级硬件,以下优化可立即提升30-50%性能:

6.1 存储路径优化

-

分离Temp目录:将

C:\Users\[User]\AppData\Local\Temp重定向到独立的SATA SSD(非系统盘),避免与Windows页面文件竞争 -

Raw文件本地化:分析前将.raw文件从网络驱动器(NAS)复制到本地NVMe SSD,分析完成后再归档,网络延迟是隐形杀手

-

关闭实时杀毒:为Xcalibur目录(

.raw文件所在位置)添加杀毒软件白名单,避免实时监控扫描大文件

6.2 Xcalibur软件参数调优

-

Memory Management:在Xcalibur Instrument Setup中,将"Disk Write Cache"设置为"Enabled"(需配合UPS防止断电)

-

Parallel Processing:在Sequence Setup中,启用"Process samples in parallel"(需确保内存>64GB,否则适得其反)

-

Method Optimization:对于高分辨数据,降低"Scan Averaging"的实时处理需求,改为后期离线处理

6.3 操作系统级优化

-

禁用SysMain(旧称Superfetch):服务

SysMain会预读大文件,对质谱数据随机读模式无效,反而占用IO -

调整页面文件:固定页面文件大小为32GB(避免动态扩展),并放置在非系统NVMe SSD上

-

启用大页面内存(Large Pages):在Windows中启用"Lock Pages in Memory"权限,提升Xcalibur大内存申请的效率

结语:别让硬盘成为科学发现的瓶颈

在质谱技术向更高分辨(Orbitrap 480,000分辨率)、更快采集(PASEF 100Hz)、更深覆盖(单细胞蛋白质组学)发展的今天,数据处理基础设施的落后正在吞噬仪器投资的价值。当您的Orbitrap以每秒数万次的频率捕捉离子时,若数据卡在硬盘的机械臂上,那不仅是时间的浪费,更是对精密仪器潜力的辜负。

从机械硬盘升级到NVMe SSD,不仅是"更快一点",而是从"批处理 overnight"到"实时分析 real-time"的范式转变。它让非靶向代谢组学的峰对齐从"睡一觉明早看结果"变为"喝杯咖啡即完成",让蛋白质组学的搜库从"周末跑两天"变为"午餐后出报告"。

UltraLAB ChromSpec系列工作站,专为色谱-质谱数据的高吞吐、高并发、低延迟需求而设计。我们理解.raw文件的内部结构,理解Xcalibur的内存映射机制,更理解色谱数据处理对"零等待"的苛刻要求。

立即联系UltraLAB,获取针对您现有质谱仪(Thermo、Waters、Agilent、Bruker、Sciex)的数据处理性能评估与升级方案。让存储速度匹配上您的分离科学与质谱解析精度。

上一篇:没有了