AI驱动的火箭发动机设计:从优化到点火打印的算力支持

引言:当航天工程遇见人工智能

在人类探索太空的70年历程中,火箭发动机的设计始终是一项"艺术+科学"的极限挑战。传统设计流程依赖工程师的经验直觉与反复试错,一个燃烧室喷注器的优化可能需要数月的风洞试验,涡轮泵的叶片造型往往历经数十轮CFD仿真。然而,随着SpaceX星舰、蓝源BE-4等新一代发动机的快速迭代,业界突然意识到:仅靠人类大脑已无法驾驭如此复杂的多元变量优化问题。

AI技术的介入正在重写游戏规则。从拓扑优化的生成式设计,到燃烧不稳定性的预测模型,再到3D打印路径的智能规划,人工智能正在将火箭发动机的设计周期从"年"压缩到"月",从"月"压缩到"周。但这一切的背后,是对算力基础设施的极端苛求——没有高性能计算平台的支撑,AI只能停留在算法论文里,无法转化为喷管中喷涌的烈焰。

一、传统设计的算力困局:为什么我们需要AI?

液体火箭发动机是地球上能量密度最高、工况最恶劣的机械系统之一。以全流量分级燃烧循环为例,其涉及:

- 多物理场强耦合:流体动力学、燃烧化学、传热传质、结构力学、声学振动在同一时空域内剧烈交互

- 极端工况跨度:从液氢-253℃的低温到燃气3000℃的高温,从地面常压到真空环境

- 几何复杂度爆炸:再生冷却通道的异形流道、喷管延伸段的变截面造型、涡轮叶片的冷却气膜孔,传统CAD难以表达最优形态

传统的基于RANS的CFD仿真,单工况计算耗时数十小时;如果要进行多目标参数扫描(如喷注器孔径、角度、流量的正交组合),设计空间爆炸将导致"算到死"的困境。而AI代理模型(Surrogate Model)的引入,通过高保真仿真数据训练神经网络,可以在毫秒级时间内预测流场特性,将设计迭代速度提升1000倍以上。

但这带来了新的问题:训练一个精确的湍流燃烧代理模型,需要海量的高保真LES/DNS仿真数据作为样本,这本身就是算力黑洞。

二、AI驱动的设计全流程:算力需求拆解

阶段一:生成式设计(Generative Design)——拓扑优化的算力跃迁

现代火箭发动机结构件(如推力室身部、涡轮泵壳体、机架)设计已普遍采用拓扑优化(Topology Optimization)与生成式设计(Generative Design)。AI算法(如SIMP、水平集法、深度学习生成网络)在满足强度、刚度、传热约束的前提下,自动演化出仿生结构。

算力特征:

- 有限元分析(FEA)密集:每一步优化迭代需重新组装刚度矩阵、求解大规模稀疏线性系统

- GPU加速需求:基于CUDA的加速算法(如NVIDIA Modulus)可将优化速度提升10-50倍

- 内存带宽敏感:复杂装配体的网格规模可达千万级,内存带宽不足将导致CPU/GPU饥饿

硬件配置要点:

- 多核高频CPU(主频≥3.5GHz)保证单步求解速度

- 大容量DDR5内存(≥512GB)容纳整机网格

- 专业级GPU(如RTX 6000 Ada)加速拓扑优化计算

阶段二:燃烧流场AI代理模型——深度学习的训练狂潮

燃烧不稳定性(Combustion Instability)是火箭发动机的"癌症"。传统的LES(大涡模拟)虽然精确,但单工况计算成本高昂。当前前沿方法采用物理信息神经网络(PINN)或卷积神经网络(CNN),用数千组LES结果训练代理模型,实现实时燃烧场预测。

算力特征:

- 显存容量决定网络规模:3D燃烧场数据维度高(时间×空间×组分),批量训练需要≥48GB显存

- NVLink多卡并行:单卡显存不足时需采用模型并行(Model Parallelism),对PCIe带宽和NVLink速度要求极高

- 高速存储I/O:训练数据集往往达数TB,需NVMe SSD阵列保证数据吞吐

硬件配置要点:

- 多路高端GPU(如RTX 6000 Ada或A100/H100)组建训练集群

- NVLink桥接实现卡间高速互联

- 全闪存存储阵列(≥10GB/s读写速度)

阶段三:多目标优化与DOE——并行计算的极限挑战

AI并非替代传统仿真,而是与之协同。在设计空间探索(Design of Experiments, DOE)阶段,需同时运行数百个CFD案例(不同喷注器布局、不同燃烧室长度),通过遗传算法(GA)或贝叶斯优化寻找帕累托前沿。

算力特征:

- Embarrassingly Parallel:各工况完全独立,完美契合集群并行

- 单节点性能与集群规模并重:既要单节点快速完成单个CFD,又要集群管理数百节点

- License成本敏感:商业CFD软件(如ANSYS Fluent、CFX)按核心授权,需平衡核心数与成本

硬件配置要点:

- 小型计算集群(4-8节点),每节点64-128核心

- 高速InfiniBand网络降低MPI通信延迟

- 混合架构:CPU节点负责传统CFD,GPU节点负责AI推理

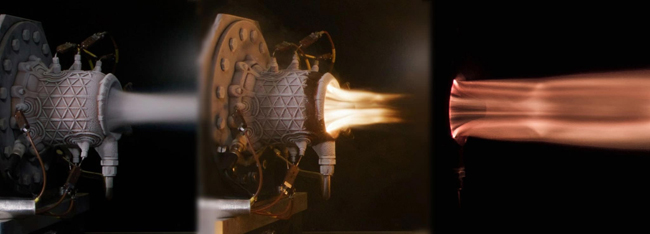

阶段四:增材制造(AM)路径规划——从比特到原子的算力桥梁

"点火打印"指的是3D打印制造环节。现代火箭发动机(如SpaceX猛禽、蓝源BE-4)广泛采用激光粉末床熔融(LPBF)或定向能量沉积(DED)打印镍基高温合金、铜铬铌燃烧室。

AI在制造阶段的作用:

- 打印方向优化:AI预测不同摆放角度对支撑结构、残余应力、表面质量的影响

- 扫描路径规划:通过深度学习避免局部过热、球化缺陷,优化激光功率与扫描速度

- 实时熔池监控:高速相机+计算机视觉实时检测未熔合、气孔缺陷

算力特征:

- 实时性要求:熔池监控需在微秒级完成图像识别,需边缘计算设备或本地推理卡

- 热-结构耦合仿真:预测打印残余应力需瞬态热分析+弹塑性力学,计算量巨大

- 点云数据处理:CT扫描检测内部缺陷产生海量点云数据,需高性能图形工作站处理

硬件配置要点:

- 工业边缘计算机(搭载NVIDIA Jetson或紧凑型GPU)用于产线实时监控

- 高精度图形工作站用于扫描路径仿真与缺陷分析

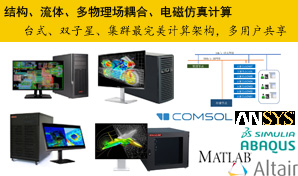

三、硬件配置方案:为航天级AI计算量身打造

针对上述四个阶段的算力需求,我们提供UltraLAB航天AI设计平台的全栈解决方案:

方案1:单兵作战型——设计师桌面超算(生成式设计+轻量级AI训练)

|

组件 |

配置规格 |

选型逻辑 |

|

CPU |

AMD Threadripper PRO 7975WX (32核64线程, 5.1GHz Boost) |

高主频保证单线程CAD响应,多核应对并行FEA |

|

内存 |

512GB DDR5-4800 ECC RDIMM (8×64GB) |

容纳千万级网格模型,ECC纠错保证长时间计算稳定性 |

|

GPU |

NVIDIA RTX pro 6000 96GB |

96GB显存容纳大尺度燃烧场训练;CUDA核心加速拓扑优化 |

|

存储 |

系统盘:2TB NVMe Gen4 SSD |

高速SSD保证大规模数据读写,RAID0提升带宽,HDD用于长期数据归档 |

|

网络 |

Dual 10GbE以太网 |

快速访问集群存储与云资源 |

|

散热 |

360mm水冷+风道优化 |

压制250W TDP处理器与双GPU满载发热,保证持续性能输出 |

适用场景: 发动机结构设计师的桌面端,运行ANSYS Mechanical拓扑优化、NVIDIA Modulus代理模型训练、PyTorch/TensorFlow深度学习开发。

方案2:团队协作型——AI计算工作站集群(多物理场仿真+大规模DOE)

|

组件 |

配置规格 |

选型逻辑 |

|

计算节点 |

4× UltraLAB GA660/GX660 |

每节点双路AMD EPYC 9535 (128核) 或 Intel Xeon 金牌8558(96核) |

|

集群总核心数 |

1024核 |

支持同时运行64个Fluent案例(每案例16核) |

|

内存配置 |

每节点768GB/1TB DDR5-4800 |

总计4TB集群内存,支持超大规模燃烧室LES模拟 |

|

互联网络 |

NVIDIA Mellanox ConnectX-6 200Gb/s InfiniBand |

极低延迟MPI通信,保证CFD并行效率 |

|

存储系统 |

100TB 并行文件系统 (Lustre/BeeGFS) |

聚合带宽≥20GB/s,支持数百个节点同时读取训练数据 |

|

管理节点 |

独立调度服务器 + AI作业管理系统 |

支持Slurm/PBS Pro调度,GPU/CPU资源动态分配 |

适用场景: 发动机总体设计部门的仿真中心,进行全尺寸发动机瞬态流固耦合分析、燃烧不稳定性多工况扫描、AI代理模型大规模训练。

方案3:智能工厂型——增材制造边缘AI节点(打印过程实时监控)

|

组件 |

配置规格 |

选型逻辑 |

|

边缘计算单元 |

NVIDIA IGX Orin或UltraLAB紧凑型工控服务器 |

工业级可靠性,抗电磁干扰,适应车间环境 |

|

AI推理卡 |

RTX A4000 或 Jetson AGX Orin |

低功耗下实现毫秒级熔池图像语义分割 |

|

数据采集 |

高速Camera Link接口,支持500fps@2K分辨率 |

捕捉微秒级熔池动态 |

|

预处理 |

FPGA加速卡 |

实时图像去噪、增强,减轻GPU负担 |

|

网络 |

5G工业模组 + TSN时间敏感网络 |

低延迟传输关键数据至云端数字孪生平台 |

适用场景: 部署于金属3D打印设备旁,实时检测打印缺陷,自动调整激光参数,实现"边打印边优化"的闭环控制。

四、软件生态与系统优化

硬件只是基础,针对航天AI设计的软件栈同样关键:

操作系统与库:

- Ubuntu 22.04 LTS 或 RHEL 9:稳定的Linux内核,支持最新GPU驱动

- CUDA Toolkit 12.x + cuDNN:GPU加速的基础

- NVIDIA Modulus / PyTorch / TensorFlow:物理信息神经网络开发框架

- ANSYS Fluent/CFX + PyFluent:商业CFD与Python AI工作流的无缝衔接

- OpenFOAM + PyTorch:开源CFD与深度学习耦合,适合定制化燃烧模型

系统级优化:

- NUMA亲和性绑定:确保CFD求解器内存访问本地性,避免跨Node延迟

- GPU Direct RDMA:存储数据直接载入GPU显存,绕过CPU内存,提升I/O效率

- 容器化部署:Docker/Singularity封装AI环境,保证不同项目依赖隔离

结语:算力即推力

当我们仰望星舰发射时的壮丽尾焰,不应忘记那背后无数个在服务器集群中闪烁的LED指示灯。AI驱动的火箭发动机设计,本质上是算法、数据与算力的三位一体。没有足够强大的计算平台,再先进的神经网络也只能是纸上谈兵;没有优化的硬件架构,昂贵的GPU资源将在等待数据中闲置。

在航天工程这个"皇冠上的明珠"领域,算力不仅是生产力,更是竞争力。从拓扑优化的第一个有限元网格,到3D打印的最后一层熔覆,每一个比特的流动都在为冲出大气层积蓄力量。选择UltraLAB,选择专业级的航天AI算力基础设施,让我们共同见证下一次点火升空背后的数字奇迹。

UltraLAB 定制图形工作站 专注高端科研计算 20 年

为航天、航空、能源领域提供从单节点工作站到大规模集群的完整AI算力解决方案

咨询电话 400-7056-800

微信号 xasun001