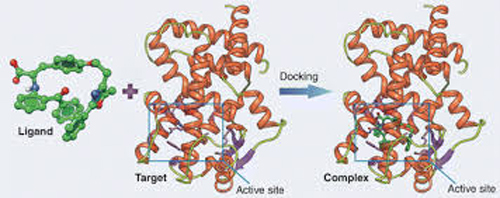

蛋白-配体对接计算:工作站配置与性能优化指南

时间:2026-03-29 20:58:31

来源:UltraLAB图形工作站方案网站

人气:50

作者:admin

从"十年磨一剑"到"一天筛亿级":GPU加速如何重构药物发现算力范式

传统分子对接计算中,一个包含100万分子库的虚拟筛选任务,在单核CPU上可能需要数周甚至数月才能完成。这种"算力焦虑"严重制约了药物发现的效率——当你面对突发公共卫生事件需要紧急筛选潜在药物分子,或需要在亿级化学空间中探索新型先导化合物时,传统CPU计算架构已触及天花板。

2025年的分子对接领域正经历算力革命:AutoDock-GPU实现56倍加速,Vina-GPU 2.1在保持精度的前提下将速度提升4.97倍,而Uni-Dock在NVIDIA V100上更是实现了超1600倍的惊人加速比,单日可完成3820万分子的虚拟筛选。

本文将深度解析蛋白-配体对接的计算特征,提供从单机工作站到GPU集群的全栈配置方案。

一、对接计算的算力画像:为什么GPU是"天作之合"

1.1 算法本质:Embarrassingly Parallel的典范

分子对接的核心算法——无论是遗传算法(LGA)、蒙特卡洛模拟退火,还是BFGS局部优化——都具有令人尴尬的并行性(Embarrassingly Parallel):

-

任务独立性:数百万配体分子与同一受体的对接计算完全独立,无数据依赖

-

构象搜索并行化:每个配体的数千种构象采样可在GPU的数千核心上同时展开

-

打分函数向量化:范德华力、静电势、氢键贡献等计算天然适合SIMD架构

AutoDock-GPU通过三级并行(runs-individual-fine-grained tasks)将LGA算法映射到GPU架构,实现了350-403倍加速。

1.2 硬件瓶颈的范式转移

| 计算阶段 | CPU瓶颈 | GPU优势 |

|---|---|---|

| 网格计算 | 单线程亲和力网格生成,受体预处理耗时 |

CUDA加速网格计算,受体只需加载一次

|

| 构象采样 | 蒙特卡洛迭代序列化,单核效率低下 |

大规模并行线程,单步搜索深度降低

|

| 能量评估 | 逐原子循环计算,内存带宽受限 | 共享内存缓存网格点,显存带宽>900GB/s |

| 批量筛选 | 每个配体重复加载受体网格,I/O灾难 |

批处理模式(--batch),受体网格常驻显存

|

关键洞察:分子对接的"内存墙"问题在GPU架构中得到缓解——现代GPU的HBM2e显存带宽(>2TB/s)配合L2缓存,可将亲和力网格的随机访问延迟降至最低。

二、工作站配置方案:从实验室到数据中心

方案A:入门级虚拟筛选工作站

适用场景:课题组日常筛选、10万级分子库、教学科研

| 组件 | 推荐配置 | 技术逻辑 |

|---|---|---|

| CPU | AMD Ryzen 9 7950X (16核/32线程) | 高主频(5.7GHz)加速受体预处理与网格计算 |

| GPU | RTX 4070 Ti SUPER 16GB | 支持AutoDock-GPU/Vina-GPU,显存满足中等规模受体 |

| 内存 | 64GB DDR5 5600MHz | 并发运行32-64个对接任务,每任务2GB冗余 |

| 存储 | 2TB NVMe Gen4 | 百万级小分子库(SDF/MOL2格式)快速加载 |

| 软件栈 | AutoDock-GPU (CUDA) + Vina-GPU 2.1 |

双引擎互补,Vina-GPU精度更高,AutoDock-GPU兼容性更广

|

性能预期:

-

AutoDock-GPU:单日筛选15-20万分子(RTX 4070 Ti SUPER)

-

Vina-GPU 2.1:相比CPU版本提速20-50倍,EF1%富集率提升342%

方案B:专业级高通量筛选服务器

适用场景:CRO公司、大型药企早期发现、千万级分子库

| 组件 | 推荐配置 | 技术逻辑 |

|---|---|---|

| CPU | AMD Threadripper PRO 5995WX (64核) | 八通道DDR5,支撑4GPU数据吞吐 |

| GPU | 双路 RTX A6000 48GB (NVLink桥接) | 96GB pooled显存,批处理百万分子无需换入换出 |

| 内存 | 256GB DDR5-4800 ECC | 预加载Enamine REAL等超大型数据库(>100GB) |

| 存储 | 4TB NVMe U.2企业级 RAID 0 | 持续读写>12GB/s,支撑批量I/O |

| 网络 | 双端口25GbE | 远程访问大型化合物库,分布式任务调度 |

性能预期:

-

Uni-Dock双卡并行:单日筛选>500万分子,速度>3.7万次对接/卡时

-

支持Schrödinger Glide SP模式主动学习筛选,10亿分子库3轮迭代

方案C:GPU集群计算节点(预算20万+/节点)

适用场景:亿级分子库虚拟筛选、紧急药物重定位(如COVID-19)、AI+对接混合计算

| 组件 | 推荐配置 | 技术逻辑 |

|---|---|---|

| CPU | 双路 AMD EPYC 9654 (96核×2) | 192核支撑千级并发,预处理受体网格 |

| GPU | 8× NVIDIA A100 80GB (NVLink全互联) |

640GB聚合显存,HBM2e带宽>2TB/s

|

| 内存 | 1TB DDR5-4800 ECC | 缓存超大规模分子库(>1TB压缩数据) |

| 存储 | 8TB NVMe + 并行文件系统 | GPFS/Lustre支撑多节点并发访问 |

| 网络 | InfiniBand HDR (200Gbps) | 跨节点GPU Direct通信,延迟<1μs |

性能预期:

-

100卡集群(如深势科技方案):11.3小时完成3820万分子筛选

-

AutoDock-GPU在Summit超算(27000 GPU):单日筛选10亿分子

三、关键硬件选型深度解析

3.1 GPU:显存容量 > 核心数量

分子对接的显存需求常被低估:

| 受体规模 | 亲和力网格大小 | 推荐显存 | 适用GPU |

|---|---|---|---|

| <50残基(激酶结构域) | ~500MB | 8GB | RTX 3070 |

| 100-300残基(标准靶点) | ~2-4GB | 16GB | RTX 4080/A4000 |

| >500残基(膜蛋白复合体) | ~10-20GB | 48GB+ | RTX A6000/A100 |

| 多受体批量筛选 | 受体数量×网格大小 | 80GB+ | A100 80GB/H100 |

关键提示:使用

--batch模式时,受体网格常驻显存,多受体筛选需累加显存占用。NVLink的900GB/s带宽对多GPU并行至关重要,避免PCIe瓶颈。

3.2 CPU:预处理阶段的"隐形主角"

虽然GPU主导对接计算,但CPU在以下环节不可替代:

-

受体预处理:PDB格式解析、质子化、亲和力网格生成(单线程密集型)

-

配体构象生成:RDKit/OpenBabel构象枚举(多线程友好)

-

结果后处理:对接姿势聚类、相互作用分析、可视化

黄金配比:1-2 CPU核心 : 1 GPU,确保预处理不阻塞GPU流水线。

3.3 存储:应对"小文件风暴"

虚拟筛选产生海量小文件(每个配体1个输出),传统HDD的随机IOPS成为瓶颈:

分层存储策略:

-

热层:NVMe SSD(>100万IOPS),存放正在筛选的批次(10-50万分子)

-

温层:SAS HDD RAID 10,存放已完成项目的对接结果

-

冷层:对象存储(MinIO/Ceph),归档历史筛选数据

关键优化:使用Vina 1.2.0的

--batch模式将多个配体合并为单次任务输出,减少文件句柄开销90%。

四、软件优化:榨干每一分算力

4.1 AutoDock-GPU性能调优

编译优化:

bash

# CUDA版本(NVIDIA GPU) make -j16 CUDA_INCLUDE_PATH=/usr/local/cuda/include \ CUDA_LIBRARY_PATH=/usr/local/cuda/lib64 # 启用双精度(对数值敏感体系) make -j16 CUDA_INCLUDE_PATH=... DOUBLE_PRECISION=1

运行参数:

bash

# 批量模式(关键!避免重复加载受体) ./autodock_gpu_128wi -B ligand_batch.list \ -M receptor.maps.fld \ -nrun 100 \ -devnum 0 1 2 3 # 多GPU指定

性能对比:

| 硬件 | 传统AutoDock4 | AutoDock-GPU | 加速比 |

|---|---|---|---|

| RTX 3090 | 56分钟 | 1分钟 | 56× |

| Tesla V100 | 45分钟 | 48秒 | 56× |

| 4核CPU | 基准 | 4核并行 | 4× |

4.2 Vina-GPU 2.1进阶优化

RILC-BFGS算法:Vina-GPU 2.1引入的Reduced Iteration and Low Complexity EGS算法,在保持精度的前提下将对接速度提升4.97倍:

bash

# 自动搜索深度调优(基于配体复杂度启发式) ./Vina-GPU-2.1 --receptor receptor.pdbqt \ --ligand_library library.sdf \ --auto_search_depth \ --thread 8000 # GPU线程数,RTX 3090建议8000-10000

精度-速度权衡:

-

高通量筛选(HTVS):

--search_depth 5,速度优先 -

标准精度(SP):

--search_depth 10,平衡选择(默认) -

高精度(XP):

--search_depth 20,先导化合物优化

4.3 多GPU并行策略

单机多卡(NVLink互联):

bash

# 使用OpenMP线程绑定 export OMP_NUM_THREADS=16 ./autodock_gpu -B batch.list -D 0,1,2,3 # 4卡并行

跨节点集群(MPI+InfiniBand):

bash

# 100卡集群运行Uni-Dock mpirun -np 100 -hostfile hosts.txt \ uni-dock --receptor receptor.pdbqt \ --ligands library.sdf \ --batch_size 100000 \ --device gpu五、常见性能陷阱与诊断

陷阱1:CPU预处理阻塞GPU流水线

症状:GPU利用率波动剧烈(0%→100%→0%),

nvidia-smi显示GPU频繁空闲。

诊断:

bash

# 监控CPU-GPU同步点 gmx mdrun -debug 2>&1 | grep "Waiting for GPU"

解决:启用批处理模式,预加载受体网格;使用独立线程池处理配体I/O。

陷阱2:显存溢出(OOM)导致任务失败

症状:大规模受体(膜蛋白复合体)对接时程序崩溃,日志显示

CUDA out of memory。

解决:

-

降低网格分辨率(

--spacing 0.5→0.375,显存占用降低50%) -

使用

--batch模式分批加载配体 -

升级至A100 80GB或启用多GPU显存池化(NVLink)

陷阱3:存储I/O成为瓶颈

症状:CPU占用率低,系统处于

D状态(不可中断睡眠),磁盘灯常亮。

解决:

-

将分子库和输出目录移至NVMe SSD

-

使用tmpfs(内存文件系统)存放临时文件:bash

mount -t tmpfs -o size=100G tmpfs /tmp/docking_scratch

六、未来趋势:AI+对接的融合架构

2025年的分子对接正从"纯物理打分"向"AI增强"演进:

-

GNINA:内置CNN打分函数,富集性能(EF1%)比传统Vina提升1倍(15.5 vs 7.1)

-

DiffDock:扩散模型直接生成结合姿势,精度接近传统对接但速度提升100倍

-

主动学习Glide:Schrödinger的Active Learning Glide通过迭代训练机器学习模型,从10亿分子库中智能筛选,仅需对0.1%分子进行高精度对接

硬件启示:AI+对接混合计算需要大显存GPU(缓存CNN模型)+高内存带宽CPU(数据预处理),A100/H100的Tensor Core对CNN打分加速至关重要。

结语:算力民主化时代

从AutoDock-GPU的开源56倍加速,到Uni-Dock的1600倍工业级性能,蛋白-配体对接计算已进入"算力民主化"时代。一套配置合理的GPU工作站,即可在单日完成传统CPU集群数周的任务量。

配置 checklist:

-

[ ] GPU显存≥受体网格大小×2(安全余量)

-

[ ] NVLink/InfiniBand互联(多GPU场景)

-

[ ] NVMe SSD存放热数据(百万级分子库)

-

[ ] 启用批处理模式(--batch)避免重复I/O

-

[ ] 使用Vina-GPU 2.1/Uni-Dock等最新GPU引擎

在药物发现的时间竞赛中,算力不再是奢侈品,而是基础设施。选择正确的硬件配置与软件优化策略,让你的对接计算从"蜗牛爬行"进化为"光速筛选"。

参考文献:

: Vina-GPU 2.1: towards further optimizing docking speed and precision of AutoDock Vina and its derivatives, IEEE/ACM Trans. Comput. Biol. Bioinform., 2024

: Accelerating AutoDock Vina with GPUs, ChemRxiv, 2022 : Schrodinger的Active Learning Glide软件对硬件要求, UltraLAB, 2024

: Accelerating AutoDock VINA with GPUs, ChemRxiv, 2021

: AutoDock-GPU:让分子对接计算速度提升56倍的终极GPU加速方案, CSDN, 2026

: Uni-Dock: GPU-Accelerated Docking Enables Ultralarge Virtual Screening, J. Chem. Theory Comput., 2023

: AutoDock Vina 1.2.0新增配体批处理对接功能, 2025

: AutoDock-GPU项目推荐, GitCode, 2024

: GPU计算和深度学习在药物发现领域中的变革作用, 腾讯云, 2022